はじめに

チームはどのようにして戦略的な野心とAIを効果的に展開、スケールアップ、管理するための実践的なステップを結びつけることができるのでしょうか?私たちのAI戦略フレームワーク(パート1)プレゼンテーションは、機会を組織的な実行に変えるツールキットを提供します。それは、方向性を定義する戦略モデル、インパクトを特定する価値創造のアプローチ、デリバリーを推進する実行の設計図、採用を維持するスケーリングフレームワーク、そして説明責任を確保するガバナンスシステムを一堂に会わせます。各フレームワークは、意思決定の品質を向上させ、ビジネスチームと技術チーム間の一致を加速し、無駄な実験を減らします。

現行の業界慣行に基づいて、これらのフレームワークは、チームがより速いイノベーションサイクル、より強力なコラボレーション、そしてAI投資からのより高いリターンを達成するのを助けます。戦略的な一貫性が断片的な実験を置き換え、ガバナンスの規律がリスクを軽減し、信頼を築きます。これらの効果が時間とともに複合すると、初期のAIプロジェクトはパフォーマンス、レジリエンス、長期的な競争優位性のスケーラブルなエンジンに進化します。

戦略

AIの潜在能力を探求する組織は、まずどこに焦点を当てるべきかという基本的な問いに直面することがよくあります。ガートナーAIオポチュニティレーダーは、顧客、製品、運用の次元を超えてユースケースをマッピングします。AIを一律の解決策として扱うのではなく、フロントオフィスの差別化を推進する機会と、内部効率を強化する機会を明らかにします。レーダーは、"日常的なAI"と変革的な賭けを区別することで、AIを単一のイニシアチブではなく、インパクトの地平線のポートフォリオとして再定義します。各地平線は、野心、投資、変更の準備度の異なる程度を要求します。

技術的な成熟度だけがAIの成功を予測するわけではありません。技術対ビジネスの準備性(TRL対BRL)モデルは、組織の能力がしばしばイノベーションに後れを取ることを明らかにします。ガバナンス、統合、ユーザーの信頼が欠けていると、画期的なアルゴリズムはあまり意味をなしません。技術的な進歩とビジネスの採用準備度の両方でイニシアチブをプロットすることで、チームはスケーリングの決定をより正確にタイミングを合わせるのに役立ちます。

市場の乱高下の中で、不確実性はAI戦略を破綻させる可能性があります。AI戦略レバー(インパクト-不確実性)フレームワークは、技術的、プロセス、人的、市場の変数がどのように長期的な優位性を形成するかを特定します。意思決定者は、自動化のスケーラビリティなどの制御可能な要素と、ベンダーの安定性や規制などの不安定な要素を分けるためにこれを使用することができます。この優先順位付けは、高インパクトなレバーに焦点を当てつつ、リスクが高い場所でのレジリエンス計画を奨励します。

価値創造

AIイニシアチブの方向性が明確になったら、次の問いは、価値がどこで、どのように形成されるかです。エンタープライズAI価値創造フレームワークは、個々のユースケースがデータ、アーキテクチャ、インパクトの変数をどのようにパフォーマンスするかを評価します。フレームワークの比較形式は、チームがデータ品質、モデルパフォーマンス、規制感度、採用可能性に基づいてユースケースを対比させることを可能にし、リソースが高収益のイニシアチブに向けられることを確保します。AIの採用が部門間で不均一な環境では、このアプローチは過度な拡大を防ぎ、増分投資が複利の利益を生む場所を強調します。

その診断的な視点を補完するために、AI Value PoolsはAIの潜在能力が機能領域にどのように分散しているかを定量化します。それはどのビジネスエリアが未開拓の価値の最も深い貯水池を保持しているかを特定します。多くの組織がAIの予算を正当化するためにプレッシャーを受けている時期に、バリュープールマッピングはより規律ある資本配分、ステークホルダーとのより鮮明なコミュニケーション、そして組織全体でのAIの展開のより良い順序付けを支援します。

実行

実行段階では、課題は機会を特定することではなく、それをビルドの決定、技術の選択、そして調整されたロールアウト計画に組み込むことです。エンタープライズAI決定パイプラインは、購入するか、構築するか、またはハイブリッドアプローチを追求するかを決定します。その論理は、コスト分析を超えて戦略的な重要性、技術的な複雑さ、および価値を生み出すまでの時間を考慮に入れます。この考慮は、Gen AIの急速な進歩が基礎的な能力が整う前に特注システムへの過剰な投資を誘うときに特に関連性があります。

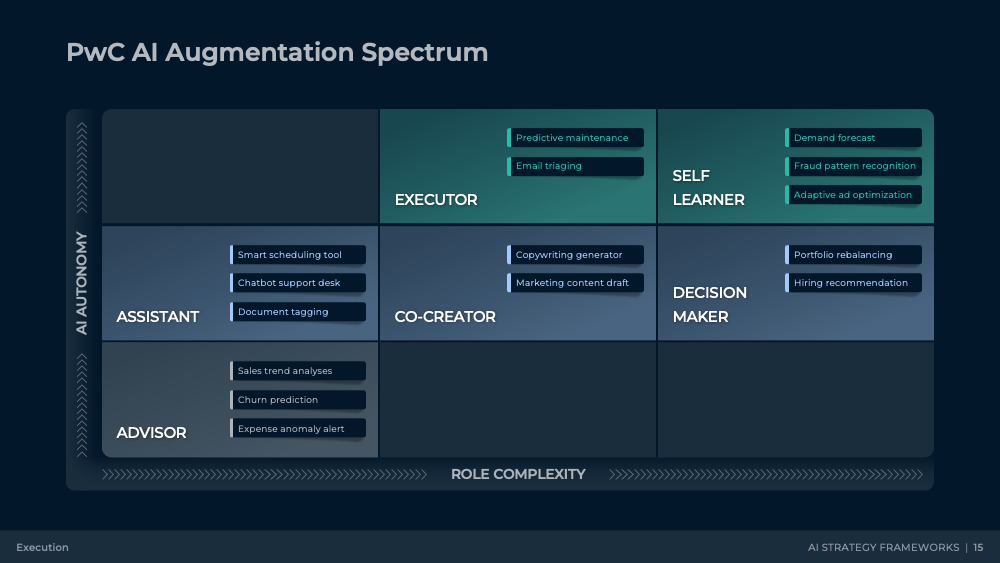

人間の能力は、AIの実行における決定的な変数であり続けています。ガートナーAIエージェンシーギャップは、機械の自律性が人間の監督と共存しなければならないことを示しています。決定論的なシステム、LLMベースのアシスタント、および人間の意思決定者を比較することで、自動化が価値を追加する場所と、判断が人間主導でなければならない場所を明らかにします。このモデルは、効率と説明責任の間のバランスをチームが調整するのを助け、AIが重要な操作に影響を与えるにつれて、規制当局と取締役会がますます厳しく監視するバランスです。

ループを閉じるために、AIロールアウトロードマップは、エクセレンスセンター、ビジネスユニット、開発チームを共有のマイルストーンの下で調整する時間ベースのコーディネーションモデルを提供します。AIの採用が成功するのは、ガバナンス、倫理、ユーザーの活用が技術的なデリバリーと並行して進行するときです。

スケーリング

AIシステムがパイロットから日常の運用に統合されるにつれて、AIシステムパフォーマンスジャーニーは技術的な進歩とユーザーエクスペリエンスが一緒に進むことを保証します。モデル開発からチューニング、パフォーマンス評価までのライフサイクルを追跡することで、人間のフィードバックとシステムロジックが同期を保つ必要性を示しています。このフレームワークは、組織が混乱なく反復を制度化するのに役立ちます。それは一回限りの最適化から継続的なパフォーマンスガバナンスへの思考をシフトさせます。

システムがスケールに達すると、次に品質評価が最前線になります。Gen AI品質評価フレームワークは、精度を超える指標を通じてパフォーマンス測定を運用化します。それは、読みやすさ、精度、類似性、プライバシーの遵守など、生成型AI出力の多面的な性質を反映する次元を考慮します。AIの品質評価は、評判、倫理、規制のリスクから保護します。それはAIの品質が技術的なベンチマークだけでなく、組織の信頼とユーザーの価値とも一致することを保証します。

ガバナンス

組織がビジネス機能全体でAIの使用を拡大するにつれて、ガバナンスは行動的およびシステム的なリスクを管理するメカニズムを提供します。AI変更採用管理は、AIがワークフローに組み込まれるにつれてチームが経験する感情的および行動的な進行をマッピングします。それは抵抗がコミュニケーションの失敗ではなく、変革への予測可能な反応であることを強調します。懐疑心、フラストレーション、実験などの段階を認識することで、リーダーは従業員を強制的なコンプライアンスではなく、情報に基づいた採用に向けて動かす介入を設計することができます。

ガバナンスの人間側を補完するために、主要リスク指標(KRIs)は倫理的な原則を定量化可能な指標に翻訳します。公正性のギャップ、説明可能性のカバレッジ、人間によるオーバーライド率を追跡することで、KRIsはしばしば定性的に扱われる領域に客観性をもたらします。これにより、取締役会、規制当局、AI評議会が、財務報告と同じ厳格さでパフォーマンスを評価することが可能になります。

結論

成熟したAI組織は、構造に基づいて構築され、偶発性には依存していません。これらのAI戦略フレームワーク(パート1)は、散発的な実験を戦略が目的を定義し、価値創造が投資を指導し、実行がデリバリーを推進し、スケーリングが信頼性を確保し、ガバナンスが信頼を維持する進歩の一貫したシステムに変えます。その結果、技術サイクルを超えて持続する規律あるイノベーションが生まれます。