مقدمة

كيف يمكن للفرق أن تربط الطموحات الاستراتيجية بالخطوات العملية لنشر وتوسيع وحكم الذكاء الاصطناعي بفعالية؟ يوفر عرضنا أطُر استراتيجية الذكاء الاصطناعي (الجزء 2) مجموعة الأدوات لتحويل الفرصة إلى تنفيذ منظم. يجمع بين نماذج الاستراتيجية التي تحدد الاتجاه، ونهج خلق القيمة التي تحدد الأثر، والخرائط التنفيذية التي تدفع التسليم، وأطُر التوسع التي تحافظ على التبني، وأنظمة الحكم التي تضمن المساءلة. كل إطار يحسن جودة القرار، ويسرع التوافق بين الفرق التجارية والتقنية، ويقلل من التجارب الضائعة.

مستندة إلى الممارسات الصناعية الحالية، تساعد هذه الأطُر الفرق على تحقيق دورات ابتكار أسرع، وتعاون أقوى، وعائدات أعلى من استثمارات الذكاء الاصطناعي. يحل الاتساق الاستراتيجي محل التجربة المجزأة، بينما يخفف الانضباط الحاكم من المخاطر ويبني الثقة. مع تراكم هذه الآثار مع مرور الوقت، تتقدم المشاريع الأولى للذكاء الاصطناعي إلى محركات قابلة للتوسع من الأداء، والمرونة، والتميز التنافسي على المدى الطويل.

الاستراتيجية

لتحقيق القيمة الحقيقية وتحقيق ميزة مستدامة مع التكنولوجيا الجديدة، يجب ألا يتم تموضع الذكاء الصناعي فقط كقدرة، ولكن كمصدر طويل الأمد للميزة التنافسية.

يعرض خريطة الرائد - المهاجر - الساكن استراتيجية الذكاء الصناعي كمسار ديناميكي بدلاً من حالة ثابتة. يوضح ما إذا كان المحفظة الحالية تؤكد على تقليد القيمة، أو تحسين القيمة، أو ابتكار القيمة، وما إذا كانت هذه الوضعية مقصودة أو عرضية. مع تصور التقدم على مر الزمن، تدفع الخريطة المحادثات الأكثر صدقاً حول الطموح مقابل الواقع. كما أنها توفر لغة مشتركة لمناقشة الموقع التنافسي، مما يسهل مواءمة قرارات الاستثمار مع مكان تريد الشركة أن تقود فيه بالفعل بدلاً من مكان تعمل فيه اليوم.

بينما يحدد الطموح الاتجاه، غالبًا ما تحدد قيود التنفيذ النتائج. يعيد نموذج BCG 10-20-70 تأطير تحديات الذكاء الصناعي بعيدًا عن التركيز الضيق على الخوارزميات والمنصات.هذا العدسة مفيدة بشكل خاص عندما تتوقف مبادرات الذكاء الاصطناعي عن التقدم على الرغم من الأسس التقنية القوية. من خلال تشخيص الاحتكاك في المهارات، والحوافز، والحكم، والأولويات، يساعد النموذج الفرق على إعادة توجيه الجهد نحو العقبات الحقيقية التي تحد من النطاق والأثر.

يجب أن يمر النوايا الاستراتيجية أيضًا بفحص الواقع. يقيم تقييم إمكانية تنفيذ الذكاء الاصطناعي من أين تأتي القيمة، ومن يعتمد على النظام، وما هي القدرات المطلوبة لتقديم النتائج. يوازن بين العائد على الاستثمار العددي والمكاسب غير المالية مثل جودة القرار وسرعة التشغيل، بحيث تعكس مناقشات الإمكانية المعادلة القيمة الكاملة بدلاً من منطق التكلفة القصيرة الأجل فقط.

خلق القيمة

يحول خلق القيمة المحادثة من النوايا الاستراتيجية إلى المادة الاقتصادية. هدفها هو جعل قيمة الذكاء الاصطناعي واضحة، قابلة للمقارنة، وقابلة للدفاع عنها، خاصة في البيئات التي يمكن أن تتجاوز الحماسة فيها الانضباط المالي.

الهندسة القيمية تقسم قيمة الذكاء الاصطناعي إلى محركات ملموسة وغير ملموسة وتوضح من أين تأتي العوائد فعليًا وكيف تتراكم مع مرور الوقت. من خلال فصل نمو الإيرادات، وكفاءة التكلفة، ومكاسب الإنتاجية عن النتائج الأكثر طيبة مثل الثقة، والأخلاق، وتقليل المخاطر، يتجنب الوقوع في الفخ الشائع للمبالغة في العائد على الاستثمار من خلال المقاييس الضيقة. مع تنافس المزيد من مبادرات الذكاء الاصطناعي على رأس المال، يسمح هذا النهج للقادة بمقارنة الحالات الاستخدام على منطق اقتصادي ثابت بدلاً من الجاذبية السردية.

تصبح الانضباط التكلفة أكثر تفصيلاً عندما يدخل النطاق الصورة. تكاليف التنفيذ الأولية، سواء كانت مدفوعة بالتطوير المخصص أو الحلول الجاهزة، نادرًا ما تروي القصة كاملة. يكسر الرؤية التكلفة الإجمالية للملكية (TCO) ومنحنى التكلفة مقابل تحقيق القيمة كيف تتطور اقتصاديات الذكاء الاصطناعي عبر الأفق الزمني. تسلط هذه الأدوات الضوء على كيفية تقديم التعقيدات التكاملية، ونمو الاستخدام، ومتطلبات البنية التحتية، والتغيير التنظيمي للتكاليف من الدرجة الثانية التي تظهر بعد الإطلاق بكثير.في الوقت نفسه، يظهرون أن القيمة غالبًا ما تتراكم بشكل غير خطي بمجرد استقرار الأنظمة وتعمق التبني.

التنفيذ

تتعثر العديد من استراتيجيات الذكاء الصناعي في نقطة الانتقال من الأفكار المعتمدة إلى الأنظمة المتينة التي تعمل في البيئات الحقيقية. يقدم نموذج قرار الذهاب/عدم الذهاب لمشروع الذكاء الصناعي لـ CPMAI بوابة منضبطة قبل التزام الموارد بالكامل. من خلال اختبار الأعمال والبيانات وإمكانية التنفيذ بشكل متوازي، يمنع النموذج المبادرات التقنية المثيرة للإعجاب ولكنها هشة عملياً من التقدم.

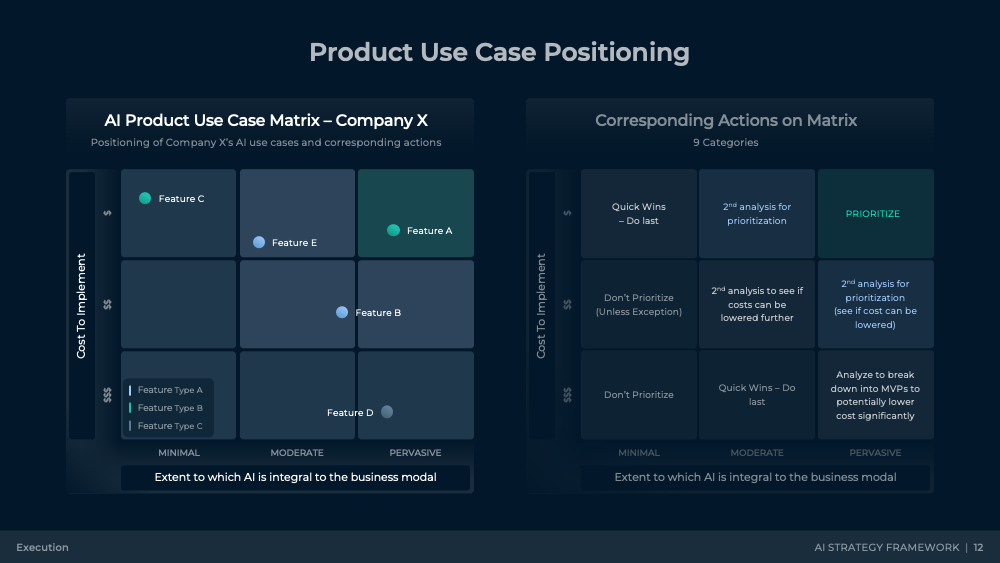

بالنسبة للمنظمات المركزة على المنتج، يعتمد وضوح التنفيذ أيضًا على اختيار نمط التفاعل الصحيح مع الذكاء الصناعي. يميز النموذج الأصلي لتجربة المنتج الذكاء الصناعي بين الدردشة، والأدوات، والمساعد، وتجارب الوكيل. بدلاً من الافتراض بالوكلاء المستقلين لأنهم يظهرون بشكل أكثر تقدمًا، يمكن للفرق توجيه تصميم المنتج مع ثقة المستخدم، وهيكل المهمة، وتحمل المخاطر.

تعتمد سرعة التسليم والثبات على كيفية تدفق العمل التطويري عبر الفرق. يسلط تحسين دورة حياة التطوير الضوء على كيف يضغط التسليم الممكن بالذكاء الاصطناعي المراحل التقليدية دون التضحية بالتحقق. من خلال طي مراحل الاكتشاف والتجربة والبناء، يقلل من الاحتكاكات التي يخلقها الملكية المعزولة والبيانات المجزأة.

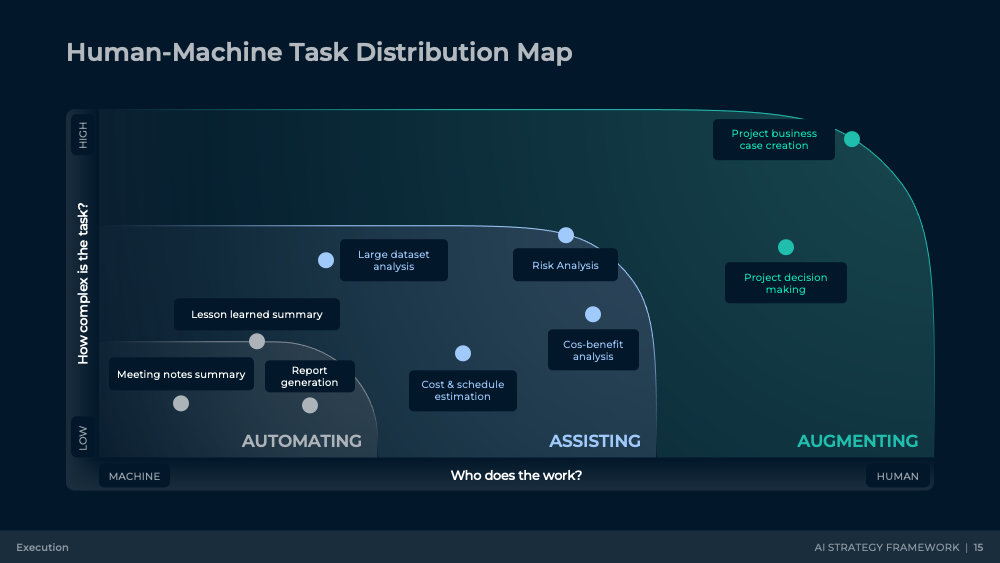

أخيرًا، يعتمد نضج التنفيذ على معرفة أين تضيف الآلات الرافعة وأين يبقى الحكم البشري أساسيًا. يوضح خريطة توزيع المهام بين الإنسان والآلة هذا الحد عبر تعقيد المهمة وحرجية القرار. يمنع هذا الإطار الالتباس في الأدوار، ويبني الثقة في نتائج الذكاء الاصطناعي، ويدعم التوسع المسؤول.

التوسع

كلما نضجت مبادرات الذكاء الاصطناعي، أصبح التوسع أكثر عن التقدم المدار حيث يتقدم الطموح التقني والثقة التنظيمية بالتوازي.

الإطار البيانات إلى الأثر الاستراتيجي يوضح كيف تتطور قدرات التحليلات كما تمتص أنظمة الذكاء الاصطناعي المزيد من البيانات وتؤثر في قرارات ذات مخاطر أعلى. يظهر أن الانتقال من الذكاء التشغيلي إلى التحليلات التنبؤية والوصفية ليس مجرد ترقية في الأدوات، بل هو تحول في كيفية تنافس الشركات. كل خطوة على طول الانحناء تتطلب صرامة أكبر في أسس البيانات، الحكم، ونضج النشر، بينما توفر أيضا مكاسب غير متناسبة في الأثر التجاري.

بمجرد أن تعمل الأنظمة على نطاق واسع، يشتد التدقيق في الأداء. النموذج الأداء ومصفوفة الالتباس، بالإقتران مع التفسير-الأداء المتبادل، يجلب هذا التدقيق إلى التركيز. المقاييس الأداء عبر التدريب، التحقق، والاختبار العالمي الحقيقي تكشف كيف تتصرف النماذج تحت ظروف متنوعة، معرضة الاستقرار، الانحراف، وخطر الحالة الحافة. بالتوازي، يجبر منحنى التفسير على التجارب الصريحة بين الدقة والقابلية للتفسير، وهو توتر يزداد حدة كلما تأثرت النماذج بنتائج العملاء، التسعير، أو القرارات الحساسة للامتثال.

الحكم

لم يعد خطر الذكاء الاصطناعي مجرد فرضية، ولا يمكن أن يكون الحكم غير رسمي بعد الآن. شجرة قرار تقييم خطر الذكاء الاصطناعي Gen AI Risk Assessment تحدد طريقة واضحة للتفكير في التعرض قبل نشر الأنظمة. يتم تصنيف الأخطار إلى خطر الإدخال، وخطر النظام، وخطر الإخراج، مما يمنع الفرق من طي خطر الذكاء الاصطناعي كله في حكم واحد. هذه الهيكلية تساعد المنظمات على التمييز بين التجربة المقبولة والأنشطة التي تتطلب ضمانات أقوى أو يجب تجنبها تماما.

بمجرد تحديد الأخطار، يعرض نموذج Risk Treatment Cost-Benefit تخفيض الخطر كخيار للاستثمار. من خلال مقارنة الخسارة المتوقعة، واحتمالية الحدوث، وتكلفة التخفيف، يمكن للقادة تبرير الإنفاق على الأمان والامتثال بمصطلحات الأعمال.

تتطلب الاعتبارات الأخلاقية نوعاً مختلفاً من الدقة.تعمل تقييم أخلاقيات الذكاء الاصطناعي الثلاثية Triadic AI Ethics Assessment على تطبيق الأخلاق عبر تصميم النظام، ورعاية البيانات، ودورة حياة النشر. من خلال رسم الخرائط للمبادئ الأخلاقية مثل العدالة، والمساءلة، والقابلية للتفسير، والخصوصية عبر المجالات المعلوماتية، والمعرفية، والفيزيائية، يتجنب معالجة الأخلاق كقائمة مراجعة لمرة واحدة. بدلاً من ذلك، يعزز أن الأداء الأخلاقي يتطور مع تطوير الأنظمة، والتفاعل مع المستخدمين، والتأثير على النتائج العالمية الحقيقية.

الخاتمة

ما يميز في النهاية البرامج الناجحة للذكاء الاصطناعي ليس تعقيد النموذج، ولكن التناسق عبر القرارات. يوفر [Name] النسيج الرابط الذي يربط الطموح بالاقتصاد، والتنفيذ بالتطوير، والابتكار بالمسؤولية. طبق هذه الأطُر للتحرك بعيدًا عن الانتصارات المعزولة نحو أنظمة الذكاء الاصطناعي التي تكون قيمة، وتكسب الثقة، وتظل متينة مع تطور التكنولوجيا، والأسواق، والتوقعات.