はじめに

チームはどのようにして戦略的な野心とAIの効果的な導入、拡大、管理の実践的なステップを結びつけることができるのでしょうか?私たちのAI戦略フレームワーク(パート2)プレゼンテーションは、機会を組織的な実行に変えるためのツールキットを提供します。それは、方向性を定義する戦略モデル、インパクトを特定する価値創造のアプローチ、デリバリーを推進する実行の設計図、採用を持続させるスケーリングフレームワーク、そして説明責任を確保するガバナンスシステムを一堂に会わせます。各フレームワークは意思決定の質を研ぎ澄ませ、ビジネスチームと技術チーム間の一致を加速させ、無駄な実験を減らします。

現行の業界慣行に基づいて、これらのフレームワークはチームがより速いイノベーションサイクル、より強力なコラボレーション、そしてAI投資からのより高いリターンを達成するのを助けます。戦略的な一貫性が断片的な実験を置き換え、ガバナンスの規律がリスクを軽減し、信頼を築きます。これらの効果が時間とともに複合すると、初期のAIプロジェクトはパフォーマンス、レジリエンス、長期的な競争優位性のスケーラブルなエンジンに進化します。

戦略

新しい技術で真の価値を実現し、持続的な優位性を達成するためには、AIは単なる能力としてではなく、長期的な競争優位性の源として位置づけるべきです。

パイオニア-移住者-定住者マップは、AI戦略を静的な状態ではなく、動的な軌道として枠組みます。それは現在のポートフォリオが価値の模倣、価値の改善、または価値の革新を強調しているか、そしてその姿勢が意図的なものであるか偶然なものであるかを明確にします。進行状況が時間と共に視覚化されるにつれて、マップは理想と現実についてより正直な会話を促進します。また、競争力のあるポジショニングについて話し合う共通の言語を提供し、組織が今日偶然に運営している場所ではなく、実際にリードしたい場所と投資決定を一致させるのを容易にします。

野心が方向性を設定する一方で、実行の制約がしばしば結果を決定します。BCGの10-20-70モデルは、AIの課題をアルゴリズムとプラットフォームに対する狭い焦点から再構築します。この視点は、技術的な基盤がしっかりしているにもかかわらずAIの取り組みが停滞するときに特に有用です。スキル、インセンティブ、ガバナンス、優先順位付けの摩擦を診断することで、モデルはチームがスケールとインパクトを制限する実際のボトルネックに努力を向けるのを助けます。

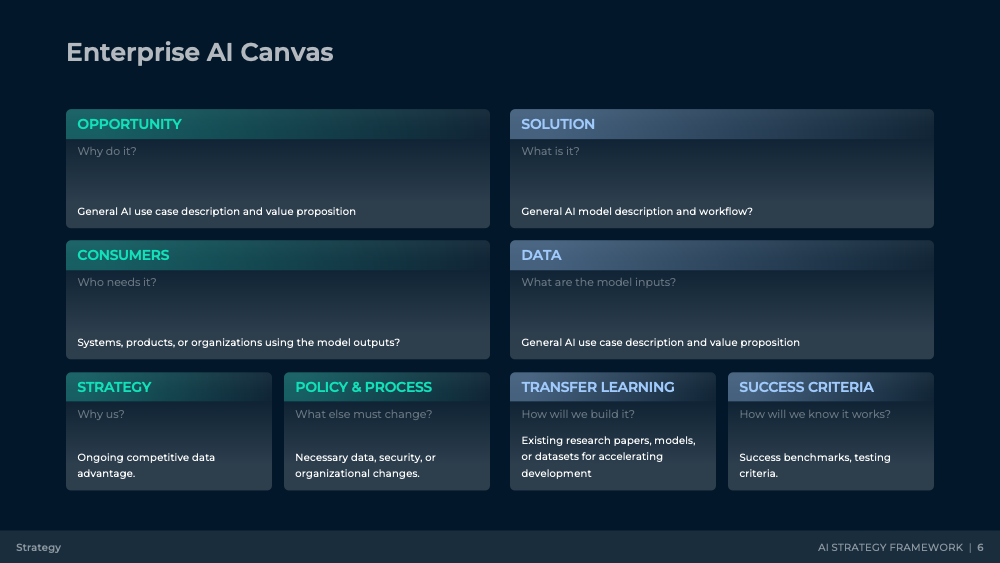

戦略的な意図もまた現実チェックを受けなければなりません。AIの実現可能性評価は、価値がどこから生じ、誰がシステムに依存し、結果を提供するために何が必要かを評価します。それは数値的なROIと意思決定の質や運用速度などの非金銭的な利益をバランスさせ、実現可能性の議論が短期的なコストロジックだけでなく、全体的な価値方程式を反映するようにします。

価値創造

価値創造は、戦略的な意図から経済的な実質へと会話をシフトさせます。その目的は、AIの価値を明確にし、比較可能にし、防御可能にすることで、特に熱意が財務的な規律を上回る環境では特に重要です。

バリューエンジニアリングはAIの価値を具体的かつ非具体的な要素に分解し、収益が実際にどこから来て、どのように時間とともに蓄積されるのかを明確にします。収益成長、コスト効率、生産性向上を信頼性、倫理、リスク軽減といったより抽象的な結果から分離することで、狭い指標を通じたROIの過大評価という一般的な罠を避けます。より多くのAIイニシアチブが資本を競う中、このアプローチはリーダーが一貫した経済的論理に基づいてユースケースを比較することを可能にし、物語性の魅力による評価を避けます。

スケールが絵に入ると、コストの規律がより微妙になります。カスタム開発や既製品による初期実装コストは、まれに全体像を伝えます。総所有コスト(TCO)の視点とコスト対価値実現の曲線は、AIの経済性が時間軸に沿ってどのように進化するかを分析します。これらのツールは、統合の複雑さ、使用の増加、インフラの要求、組織変更が、ローンチ後に表面化する二次コストを導入する方法を強調します。同時に、システムが安定し、採用が深まると、価値は非線形に複合化することが多いことを示しています。

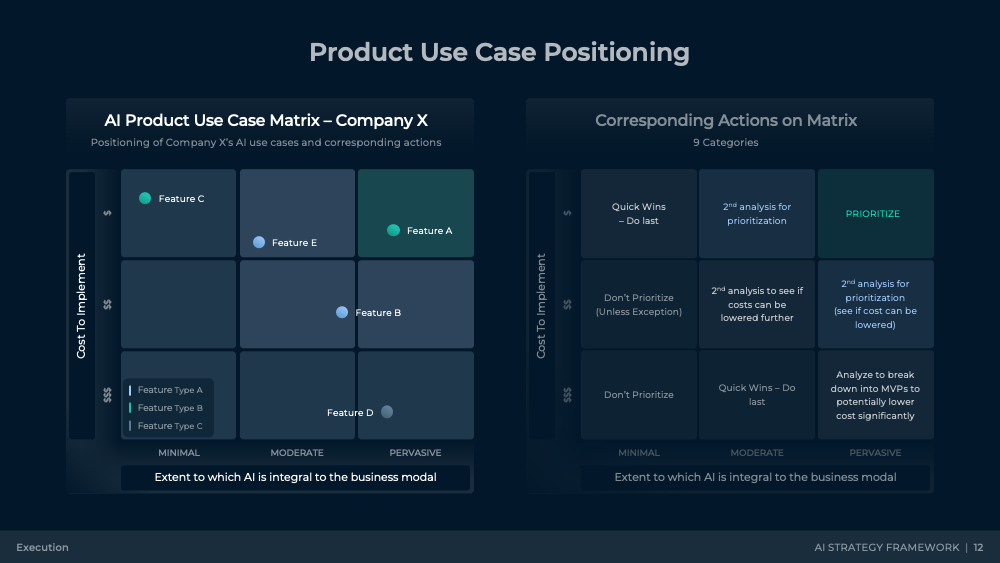

実行

多くのAI戦略は、承認されたアイデアから実際の環境で運用する耐久性のあるシステムへの移行の段階でつまずきます。CPMAIのAIプロジェクトのGo/No-Go決定モデルは、リソースが完全にコミットする前に厳格なゲートを導入します。ビジネス、データ、実装の実現可能性を並行してテストすることで、モデルは技術的に印象的だが運用上は壊れやすいイニシアチブが進行するのを防ぎます。

製品中心の組織では、実行の明確さはまた、適切なAIインタラクションパターンを選択することにも依存します。AI製品体験アーキタイプは、チャット、ツール、コパイロット、エージェントベースの体験を区別します。チームは、より進んでいるように見えるために自律エージェントにデフォルト設定するのではなく、製品デザインをユーザーの信頼、タスク構造、リスク許容度と一致させることができます。

デリバリーの速度と一貫性は、開発作業がチーム間でどのように流れるかにかかっています。開発ライフサイクルの最適化は、AIによるデリバリーが伝統的なステージを犠牲にすることなく圧縮する方法を強調しています。発見、実験、ビルドのサイクルを短縮することで、所有権の分断やデータの断片化によって生じる摩擦を減らします。

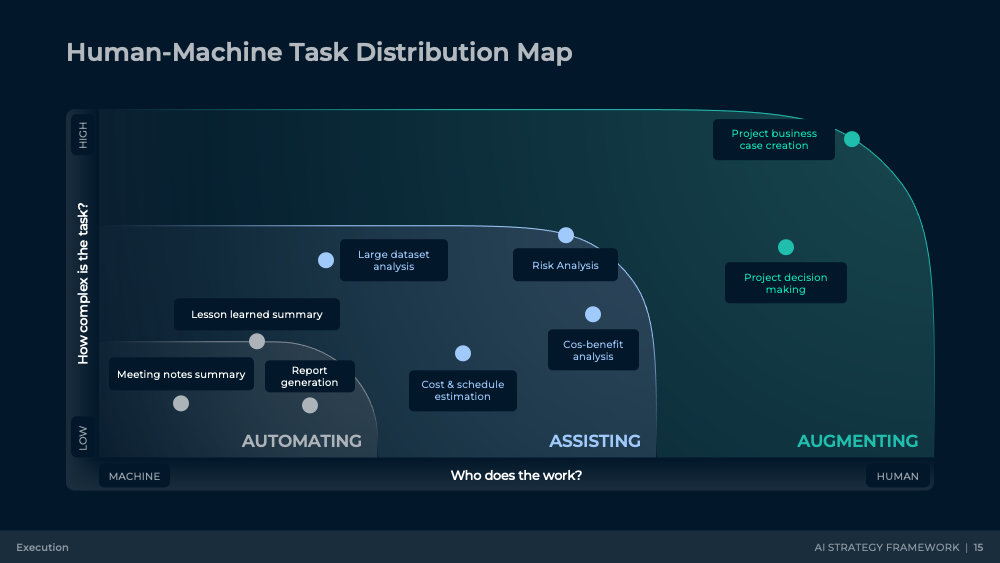

最後に、実行の成熟度は、マシンがどこでレバレッジを加え、人間の判断が依然として必要な場所を知ることに依存します。人間-マシンタスク分布マップは、タスクの複雑さと決定の重要性を通じてその境界を視覚化します。このフレームワークは役割の混乱を防ぎ、AIの出力に対する信頼を築き、責任あるスケーリングを支援します。

スケーリング

AIの取り組みが成熟するにつれて、スケーリングは技術的な野心と組織的な信頼が並行して進む管理された進行についてのものになります。

データから戦略への影響フレームワークは、AIシステムがより多くのデータを吸収し、より高いステークの決定に影響を与えるにつれて、分析能力がどのように進化するかを明確にします。これは、運用インテリジェンスから予測的および処方的な分析への移行が単なるツールのアップグレードではなく、組織が競争する方法の変化であることを示しています。カーブに沿った各ステップは、データの基盤、ガバナンス、展開の成熟度においてより大きな厳格さを要求し、同時にビジネスインパクトにおいて不釣り合いな利益をもたらします。

システムがスケールで動作すると、パフォーマンスの厳密な検討が強まります。モデルパフォーマンスと混同行列、および解釈可能性とパフォーマンスのトレードオフは、その厳密な検討を焦点化します。トレーニング、検証、実世界のテストを通じてのパフォーマンス指標は、モデルがさまざまな条件下でどのように振る舞うかを明らかにし、安定性、ドリフト、エッジケースのリスクを露呈します。並行して、解釈可能性のカーブは、精度と説明可能性の間の明確なトレードオフを強制し、モデルが顧客の結果、価格設定、またはコンプライアンスに敏感な決定に影響を与えるにつれて、その緊張が鋭くなります。

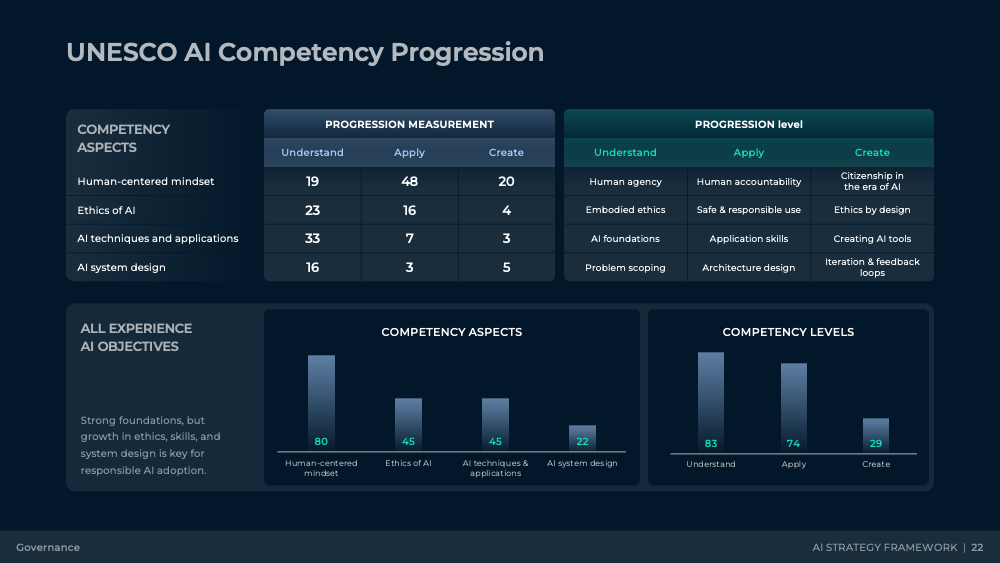

ガバナンス

AIのリスクはもはや仮説的なものではなく、ガバナンスもまた非公式なものではありません。Gen AI Risk Assessmentの決定木は、システムが展開される前にリスクの露出について明確に理解する方法を確立します。リスクは入力リスク、システムリスク、出力リスクに分類され、これによりチームがすべてのAIリスクを一つの判断にまとめることを防ぎます。この構造は、組織が許容可能な実験と、より強固な保護措置が必要な活動、または完全に避けるべき活動を区別するのに役立ちます。

リスクが特定されたら、Risk Treatment Cost-Benefitモデルはリスク軽減を投資選択として枠組みます。期待損失、発生確率、軽減コストを比較することで、リーダーはセキュリティとコンプライアンスの支出をビジネス用語で正当化することができます。

倫理的な考慮事項は、異なる種類の厳格さを必要とします。三位一体のAI倫理評価は、システム設計、データ管理、展開ライフサイクル全体にわたって倫理を運用化します。公正、説明責任、説明可能性、プライバシーなどの倫理原則を情報、認知、物理の領域にマッピングすることで、倫理を一度きりのチェックリストとして扱うことを避けます。代わりに、システムがスケールアップし、ユーザーと相互作用し、現実の結果に影響を与えるにつれて、倫理的なパフォーマンスが進化することを強調します。

結論

AIプログラムが成功する最終的な差別化要因は、モデルの洗練度ではなく、決定全体の一貫性です。[Name]は、野心を経済性に、実行をスケールに、イノベーションを責任に結びつける結合組織を提供します。これらのフレームワークを適用して、孤立した勝利を超えて、価値を複合化し、信頼を獲得し、技術、市場、期待が進化する中で耐久性を保つAIシステムに向けて前進します。