Einführung

Wie können Teams strategische Ambitionen mit den praktischen Schritten zur effektiven Implementierung, Skalierung und Steuerung von KI überbrücken? Unsere KI-Strategierahmen (Teil 2) Präsentation bietet das Toolkit, um Chancen in organisierte Ausführung umzuwandeln. Sie bringt Strategiemodelle zusammen, die die Richtung definieren, Ansätze zur Wertschöpfung, die den Einfluss präzisieren, Ausführungspläne, die die Lieferung vorantreiben, Skalierungsrahmen, die die Übernahme aufrechterhalten, und Governance-Systeme, die die Rechenschaftspflicht sicherstellen. Jeder Rahmen verbessert die Qualität der Entscheidungen, beschleunigt die Abstimmung zwischen Geschäfts- und Technikteams und reduziert verschwendete Experimente.

Auf aktuellen Branchenpraktiken basierend, helfen diese Rahmen den Teams, schnellere Innovationszyklen, stärkere Zusammenarbeit und höhere Renditen aus KI-Investitionen zu erzielen. Strategische Konsistenz ersetzt fragmentierte Experimente, während Governance-Disziplin Risiken mindert und Vertrauen aufbaut. Im Laufe der Zeit verstärken sich diese Effekte, und frühe KI-Projekte entwickeln sich zu skalierbaren Leistungsmotoren, Resilienz und langfristiger Wettbewerbsdifferenzierung.

Strategie

Um echten Wert zu erzielen und einen nachhaltigen Vorteil mit neuer Technologie zu erzielen, sollte KI nicht nur als Fähigkeit positioniert werden, sondern als langfristige Quelle für Wettbewerbsvorteile.

Die Pioneer–Migrator–Settler Map stellt die KI-Strategie als dynamische Trajektorie und nicht als statischen Zustand dar. Sie artikuliert, ob das aktuelle Portfolio Wertimitation, Wertverbesserung oder Wertinnovation betont und ob diese Haltung absichtlich oder zufällig ist. Da Fortschrittsbewegungen im Laufe der Zeit visualisiert werden, fördert die Karte ehrlichere Gespräche über Bestrebungen im Vergleich zur Realität. Sie bietet auch eine gemeinsame Sprache, um die Wettbewerbspositionierung zu diskutieren, was es einfacher macht, Investitionsentscheidungen mit dem Ort in Einklang zu bringen, an dem die Organisation tatsächlich führen möchte, anstatt dort, wo sie heute zufällig operiert.

Während Ambitionen die Richtung vorgeben, bestimmen Ausführungsbeschränkungen oft die Ergebnisse. Das BCG’s 10–20–70 Modell rückt KI-Herausforderungen von einem engen Fokus auf Algorithmen und Plattformen ab.Diese Perspektive ist besonders nützlich, wenn KI-Initiativen trotz starker technischer Grundlagen ins Stocken geraten. Durch die Diagnose von Reibungspunkten in Fähigkeiten, Anreizen, Governance und Priorisierung hilft das Modell den Teams, die Anstrengungen auf die tatsächlichen Engpässe zu lenken, die Skalierung und Einfluss begrenzen.

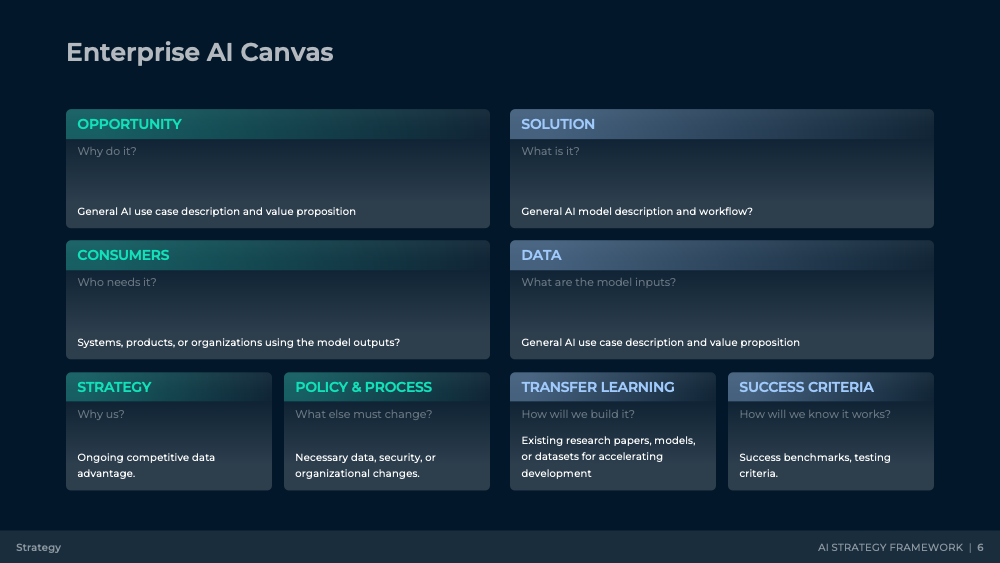

Die strategische Absicht muss auch einen Realitätscheck bestehen. Die KI-Machbarkeitsbewertung bewertet, wo der Wert entsteht, wer auf das System angewiesen ist und welche Fähigkeiten erforderlich sind, um Ergebnisse zu liefern. Sie gleicht den numerischen ROI mit nicht-finanziellen Gewinnen wie Entscheidungsqualität und operativer Geschwindigkeit aus, so dass Machbarkeitsdiskussionen die gesamte Wertgleichung widerspiegeln, anstatt sich allein auf die kurzfristige Kostenlogik zu stützen.

Wertschöpfung

Die Wertschöpfung verlagert das Gespräch von der strategischen Absicht zur wirtschaftlichen Substanz. Ihr Zweck ist es, den Wert der KI explizit, vergleichbar und verteidigbar zu machen, insbesondere in Umgebungen, in denen die Begeisterung die finanzielle Disziplin überholen kann.

Werttechnik zerlegt den KI-Wert in greifbare und nicht greifbare Treiber und klärt, wo die Renditen tatsächlich herkommen und wie sie sich im Laufe der Zeit ansammeln. Durch die Trennung von Umsatzwachstum, Kosteneffizienz und Produktivitätsgewinnen von weicheren Ergebnissen wie Vertrauen, Ethik und Risikominderung vermeidet sie die häufige Falle, den ROI durch enge Metriken zu überschätzen. Da immer mehr KI-Initiativen um Kapital konkurrieren, ermöglicht dieser Ansatz Führungskräften, Anwendungsfälle auf einer konsistenten wirtschaftlichen Logik statt auf narrativer Anziehungskraft zu vergleichen.

Die Kostenkontrolle wird nuancierter, wenn die Skalierung ins Spiel kommt. Die anfänglichen Implementierungskosten, ob durch kundenspezifische Entwicklung oder Standardlösungen verursacht, erzählen selten die ganze Geschichte. Die Gesamtbetriebskosten (TCO) und die Kosten- gegen Wertrealisierung Kurve zeigen, wie sich die KI-Ökonomie über Zeithorizonte hinweg entwickelt. Diese Werkzeuge heben hervor, wie Integrationskomplexität, Nutzerwachstum, Infrastrukturanforderungen und organisatorischer Wandel sekundäre Kosten einführen, die lange nach dem Start auftauchen.Gleichzeitig zeigen sie, dass der Wert oft nichtlinear ansteigt, sobald sich die Systeme stabilisieren und die Annahme vertieft.

Ausführung

Viele KI-Strategien scheitern an dem Punkt, an dem sie von genehmigten Ideen zu robusten Systemen übergehen, die in realen Umgebungen arbeiten. Das KI-Projekt Go/No-Go-Entscheidungsmodell von CPMAI führt eine disziplinierte Schranke ein, bevor Ressourcen vollständig gebunden werden. Durch parallele Überprüfung der Geschäfts-, Daten- und Implementierungsmöglichkeiten verhindert das Modell, dass technisch beeindruckende, aber betrieblich fragile Initiativen voranschreiten.

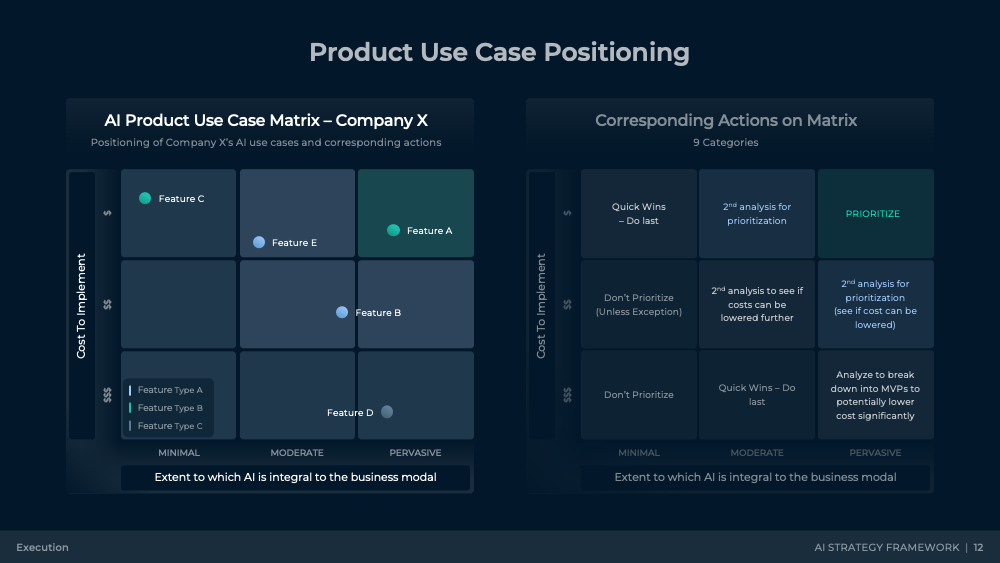

Für produktzentrierte Organisationen hängt die Klarheit der Ausführung auch von der Wahl des richtigen KI-Interaktionsmusters ab. Der KI-Produkt-Erfahrungsarchetyp unterscheidet zwischen Chat-, Tool-, Copilot- und Agenten-basierten Erfahrungen. Anstatt standardmäßig auf autonome Agenten zurückzugreifen, weil sie fortschrittlicher erscheinen, können Teams das Produktdesign mit Benutzervertrauen, Aufgabenstruktur und Risikotoleranz abstimmen.

Die Geschwindigkeit und Konsistenz der Lieferung hängen davon ab, wie die Entwicklungsarbeit zwischen den Teams fließt. Optimierung des Entwicklungslebenszyklus zeigt, wie KI-gestützte Lieferung traditionelle Stufen komprimiert, ohne die Validierung zu opfern. Durch das Zusammenführen von Entdeckung, Experimentierung und Aufbauzyklen werden Reibungsverluste durch isolierte Eigentümerschaft und fragmentierte Daten reduziert.

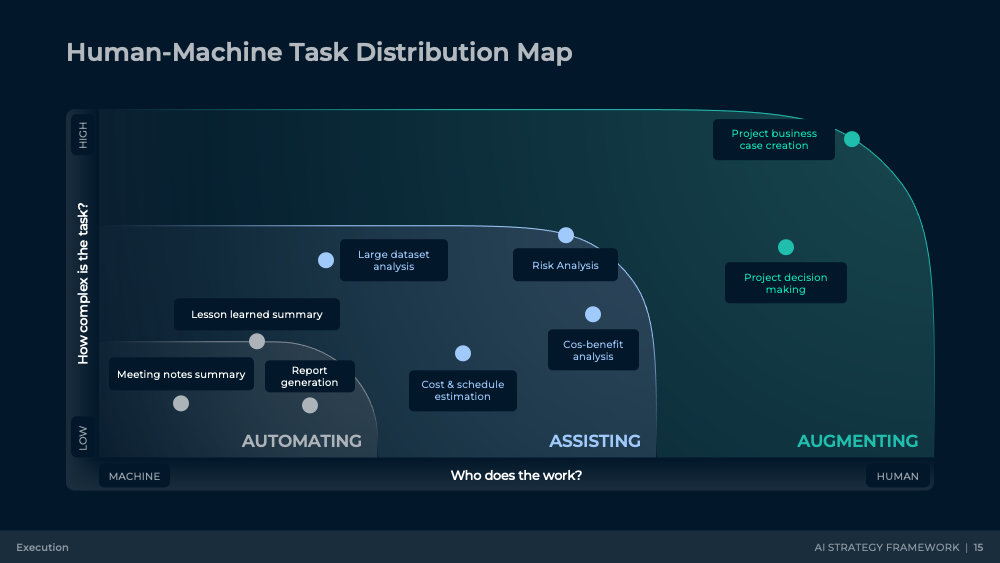

Schließlich hängt die Reife der Ausführung davon ab, zu wissen, wo Maschinen Hebelwirkung erzeugen und wo menschliches Urteilsvermögen unerlässlich bleibt. Die Karte zur Aufgabenverteilung zwischen Mensch und Maschine visualisiert diese Grenze über die Komplexität der Aufgaben und die Kritikalität der Entscheidung. Dieser Rahmen verhindert Rollenverwirrung, schafft Vertrauen in KI-Ergebnisse und unterstützt eine verantwortungsvolle Skalierung.

Skalierung

Mit der Reife von KI-Initiativen wird die Skalierung mehr zu einer gesteuerten Progression, bei der technischer Ehrgeiz und organisatorisches Vertrauen parallel voranschreiten.

Das Data-to-Strategy Impact Framework verdeutlicht, wie sich die Analysefähigkeiten entwickeln, wenn KI-Systeme mehr Daten aufnehmen und Entscheidungen mit höheren Einsätzen beeinflussen. Es zeigt, dass der Übergang von operativer Intelligenz zu prädiktiver und präskriptiver Analytik nicht nur ein Upgrade der Werkzeuge ist, sondern eine Veränderung in der Art und Weise, wie Organisationen konkurrieren. Jeder Schritt entlang der Kurve erfordert mehr Sorgfalt in den Datenfundamenten, der Governance und der Reife der Implementierung, während er auch unverhältnismäßige Gewinne in der Geschäftsauswirkung liefert.

Sobald Systeme im großen Maßstab arbeiten, intensiviert sich die Leistungsprüfung. Die Model Performance and Confusion Matrix, gepaart mit dem Interpretability-Performance Trade-off, bringt diese Prüfung in den Fokus. Leistungsmetriken über Training, Validierung und Tests in der realen Welt zeigen, wie Modelle unter verschiedenen Bedingungen reagieren, und decken Stabilität, Drift und Risiken in Randfällen auf. Parallel dazu zwingt die Interpretierbarkeitskurve zu expliziten Kompromissen zwischen Genauigkeit und Erklärbarkeit, eine Spannung, die zunimmt, wenn Modelle Kundenergebnisse, Preisgestaltung oder compliance-sensible Entscheidungen beeinflussen.

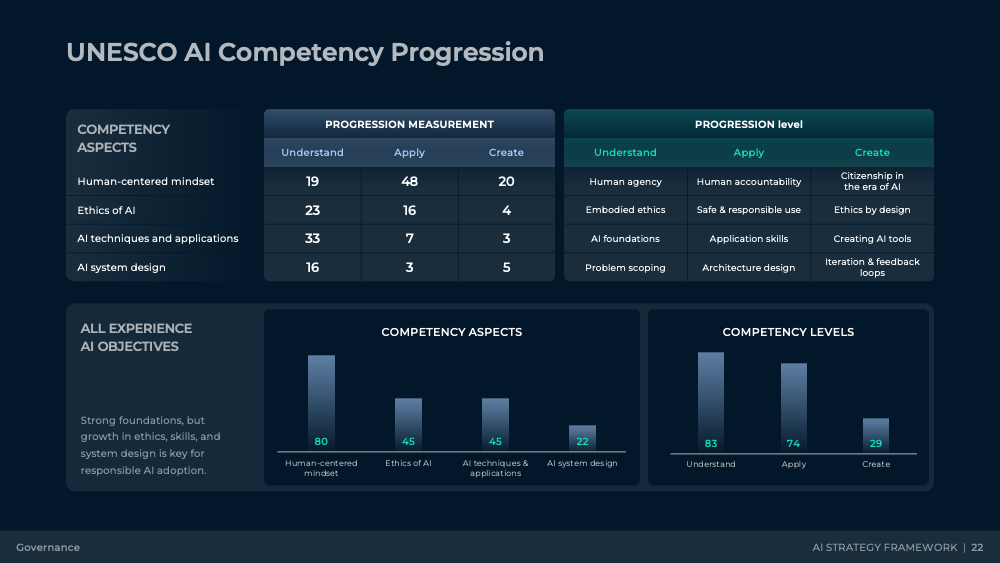

Governance

Das Risiko der KI ist nicht mehr hypothetisch und die Governance kann nicht mehr informell sein. Der Entscheidungsbaum Gen AI Risk Assessment legt einen klaren Weg zur Beurteilung der Exposition fest, bevor Systeme eingesetzt werden. Risiken werden in Eingaberisiko, Systemrisiko und Ausgaberisiko unterteilt, was verhindert, dass Teams das gesamte KI-Risiko in ein einziges Urteil zusammenfassen. Diese Struktur hilft Organisationen, zwischen akzeptablen Experimenten und Aktivitäten zu unterscheiden, die stärkere Sicherheitsvorkehrungen erfordern oder ganz vermieden werden sollten.

Sobald Risiken identifiziert sind, stellt das Modell Risk Treatment Cost-Benefit die Risikominderung als Investitionsentscheidung dar. Durch den Vergleich von erwartetem Verlust, Eintrittswahrscheinlichkeit und Minderungskosten können Führungskräfte Sicherheits- und Compliance-Ausgaben in Geschäftsbegriffen rechtfertigen.

Ethik erfordert eine andere Art von Strenge.Die Triadische KI-Ethikbewertung operationalisiert Ethik in den Bereichen Systemdesign, Datenverwaltung und Implementierungslebenszyklus. Durch die Kartierung ethischer Prinzipien wie Fairness, Rechenschaftspflicht, Erklärbarkeit und Datenschutz in den Bereichen Information, Kognition und physische Domänen wird vermieden, dass Ethik als einmalige Checkliste behandelt wird. Stattdessen wird betont, dass die ethische Leistung sich weiterentwickelt, wenn Systeme skaliert werden, mit Benutzern interagieren und reale Ergebnisse beeinflussen.

Fazit

Was letztendlich erfolgreiche KI-Programme unterscheidet, ist nicht die Modellkomplexität, sondern die Kohärenz über Entscheidungen hinweg. [Name] bietet das verbindende Element, das Ambitionen mit Wirtschaftlichkeit, Ausführung mit Skalierung und Innovation mit Verantwortung verknüpft. Wenden Sie diese Rahmenbedingungen an, um über isolierte Erfolge hinaus zu KI-Systemen zu gelangen, die Wert steigern, Vertrauen verdienen und dauerhaft bestehen, während sich Technologien, Märkte und Erwartungen weiterentwickeln.