Wprowadzenie

Jak zespoły mogą łączyć strategiczne ambicje z praktycznymi krokami do wdrożenia, skalowania i skutecznego zarządzania AI? Nasza prezentacja Ramowe strategie AI (Część 2) dostarcza zestaw narzędzi, aby przekształcić możliwości w zorganizowane wykonanie. Łączy modele strategii, które definiują kierunek, podejścia do tworzenia wartości, które wskazują na wpływ, niebieskie plany wykonania, które napędzają dostawę, ramy skalowania, które utrzymują adopcję, i systemy zarządzania, które zapewniają odpowiedzialność. Każda ramowa strategia wyostrza jakość decyzji, przyspiesza zgodność między zespołami biznesowymi i technicznymi, i redukuje marnowanie eksperymentów.

Zakorzenione w obecnych praktykach branżowych, te ramowe strategie pomagają zespołom osiągać szybsze cykle innowacji, silniejszą współpracę i wyższe zwroty z inwestycji w AI. Strategiczna spójność zastępuje fragmentaryczne eksperymentowanie, podczas gdy dyscyplina zarządzania łagodzi ryzyko i buduje zaufanie. W miarę jak te efekty narastają z czasem, wczesne projekty AI przechodzą w skalowalne silniki wydajności, odporności i długoterminowej konkurencyjnej różnicy.

Strategia

Aby zrealizować prawdziwą wartość i osiągnąć trwałą przewagę dzięki nowej technologii, AI nie powinno być postrzegane tylko jako zdolność, ale jako długoterminowe źródło konkurencyjnej przewagi.

Mapa Pionier–Migrator–Osadnik przedstawia strategię AI jako dynamiczną trajektorię, a nie statyczny stan. Wyjaśnia, czy obecne portfolio kładzie nacisk na imitację wartości, poprawę wartości, czy innowacje wartości, i czy ta postawa jest zamierzona, czy przypadkowa. W miarę jak ruchy postępu są wizualizowane w czasie, mapa prowadzi do bardziej szczerych rozmów na temat aspiracji wobec rzeczywistości. Zapewnia również wspólny język do omówienia pozycji konkurencyjnej, co ułatwia dostosowanie decyzji inwestycyjnych do miejsca, w którym organizacja naprawdę chce prowadzić, a nie tam, gdzie działa obecnie.

Podczas gdy ambicja wyznacza kierunek, ograniczenia wykonania często determinują wyniki. Model BCG 10–20–70 przedstawia wyzwania AI z dala od wąskiego skupienia na algorytmach i platformach.To spojrzenie jest szczególnie przydatne, gdy inicjatywy AI zatrzymują się pomimo silnych podstaw technicznych. Diagnozując tarcie w umiejętnościach, motywacjach, zarządzaniu i priorytetach, model pomaga zespołom przekierować wysiłki na rzeczywiste wąskie gardła, które ograniczają skalę i wpływ.

Strategiczne zamiary muszą również przejść test rzeczywistości. Ocena Wykonalności AI ocenia, skąd pochodzi wartość, kto zależy od systemu i jakie zdolności są wymagane do dostarczenia wyników. Bilansuje numeryczny ROI z niefinansowymi korzyściami, takimi jak jakość decyzji i szybkość operacyjna, tak aby dyskusje o wykonalności odzwierciedlały pełne równanie wartości, a nie tylko krótkoterminową logikę kosztów.

Tworzenie Wartości

Tworzenie wartości przesuwa rozmowę od strategicznego zamiaru do ekonomicznej substancji. Jego celem jest uczynienie wartości AI wyraźną, porównywalną i obroną, szczególnie w środowiskach, gdzie entuzjazm może wyprzedzać finansową dyscyplinę.

Inżynieria wartości rozkłada wartość AI na namacalne i nienamacalne czynniki i wyjaśnia, skąd faktycznie pochodzą zyski i jak gromadzą się z czasem. Rozdzielając wzrost przychodów, efektywność kosztową i zyski z produktywności od bardziej subtelnych wyników, takich jak zaufanie, etyka i redukcja ryzyka, unika się powszechnej pułapki przeceniania ROI za pomocą wąskich wskaźników. W miarę jak więcej inicjatyw AI konkurować o kapitał, to podejście pozwala liderom porównywać przypadki użycia na podstawie spójnej logiki ekonomicznej, a nie atrakcyjności narracji.

Dyscyplina kosztów staje się bardziej zróżnicowana, gdy do obrazu wkracza skala. Początkowe koszty implementacji, czy są one napędzane przez rozwój na zamówienie czy gotowe rozwiązania, rzadko opowiadają całą historię. Widok Całkowitego kosztu posiadania (TCO) i krzywa Koszt vs. Realizacja wartości rozkładają, jak ekonomia AI ewoluuje w różnych horyzontach czasowych. Te narzędzia podkreślają, jak złożoność integracji, wzrost użytkowania, wymagania infrastruktury i zmiany organizacyjne wprowadzają koszty drugiego rzędu, które pojawiają się długo po uruchomieniu.Jednocześnie pokazują, że wartość często zwiększa się nieliniowo, gdy systemy stabilizują się, a adopcja się pogłębia.

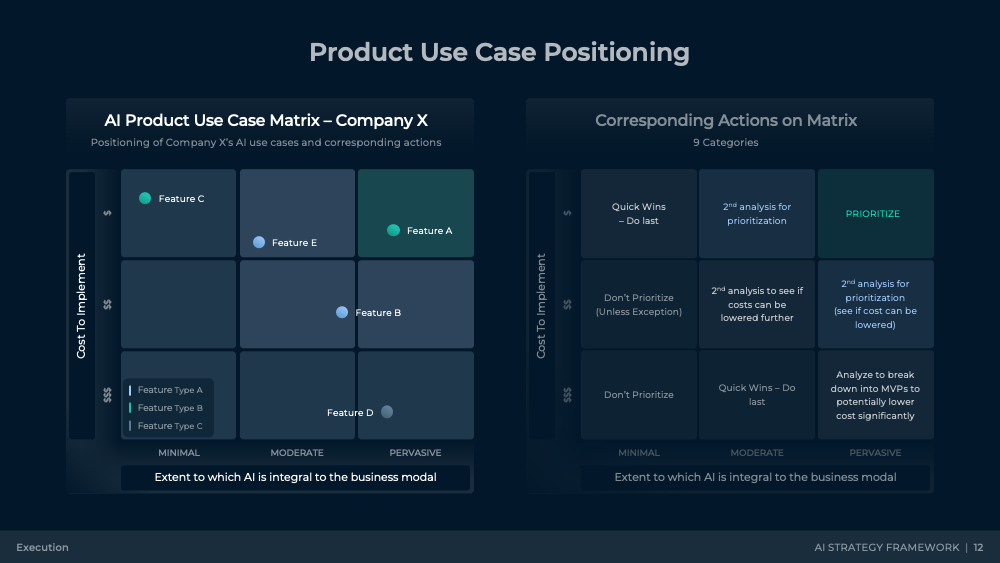

Wykonanie

Wiele strategii AI zawodzi w momencie przejścia od zatwierdzonych pomysłów do trwałych systemów, które działają w rzeczywistych środowiskach. Model Decyzji o Kontynuacji/Przerwaniu Projektu AI CPMAI wprowadza zasady przed pełnym zaangażowaniem zasobów. Testując równolegle możliwości biznesowe, dane i możliwości implementacji, model zapobiega postępowi technicznie imponujących, ale operacyjnie kruchych inicjatyw.

Dla organizacji zorientowanych na produkt, jasność wykonania zależy również od wyboru właściwego wzorca interakcji AI. Archetyp Doświadczenia Produktu AI rozróżnia między czatem, narzędziem, kopilotem i doświadczeniami opartymi na agentach. Zamiast domyślnie wybierać autonomicznych agentów, ponieważ wydają się bardziej zaawansowani, zespoły mogą dostosować projekt produktu do zaufania użytkownika, struktury zadania i tolerancji na ryzyko.

Szybkość dostawy i jej konsekwencja zależą od tego, jak praca rozwojowa przepływa między zespołami. Optymalizacja cyklu życia rozwoju pokazuje, jak dostawa z wykorzystaniem AI kompresuje tradycyjne etapy bez poświęcania walidacji. Poprzez skracanie odkrycia, eksperymentacji i cykli budowy, redukuje tarcia powstałe przez rozproszone własności i fragmentaryczne dane.

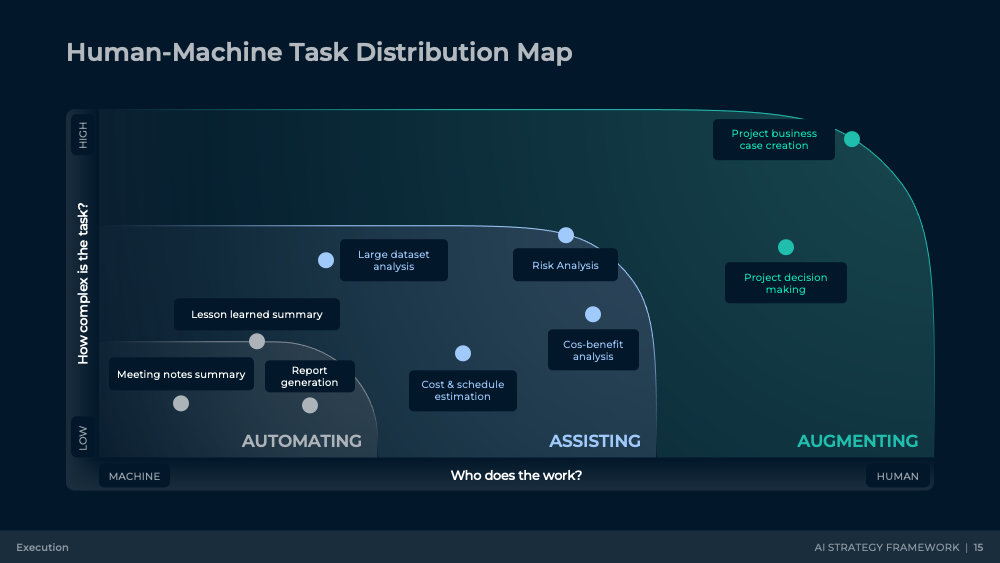

W końcu, dojrzałość wykonania zależy od wiedzy, gdzie maszyny dodają dźwigni, a gdzie niezbędny jest ludzki osąd. Mapa dystrybucji zadań człowieka-maszyna wizualizuje tę granicę w całej złożoności zadania i krytyczności decyzji. Ten framework zapobiega zamieszaniu ról, buduje zaufanie do wyników AI i wspiera odpowiedzialne skalowanie.

Skalowanie

W miarę dojrzewania inicjatyw AI, skalowanie staje się bardziej zarządzanym postępem, gdzie techniczne ambicje i zaufanie organizacyjne rozwijają się równolegle.

Ramowy model Wpływu Danych na Strategię wyjaśnia, jak zdolności analityczne ewoluują, gdy systemy AI absorbują więcej danych i wpływają na decyzje o wyższych stawkach. Pokazuje, że przejście od operacyjnej inteligencji do analityki predykcyjnej i preskryptywnej nie jest tylko uaktualnieniem narzędzi, ale zmianą w sposobie, w jaki organizacje konkurują. Każdy krok wzdłuż krzywej wymaga większej rygorystyczności w fundamentach danych, zarządzaniu i dojrzałości wdrożenia, dostarczając jednocześnie niewspółmiernych zysków w wpływie na biznes.

Gdy systemy działają w skali, intensyfikuje się kontrola wydajności. Model Wydajności i Macierz Pomyłek, w parze z Kompromisem między Interpretowalnością a Wydajnością, skupiają tę kontrolę. Metryki wydajności na przestrzeni szkolenia, walidacji i testów w rzeczywistym świecie ujawniają, jak modele zachowują się w różnych warunkach, ujawniając stabilność, dryf i ryzyko przypadków skrajnych. Równolegle, krzywa interpretowalności wymusza wyraźne kompromisy między dokładnością a wyjaśnialnością, napięcie, które staje się ostrzejsze, gdy modele wpływają na wyniki klientów, ceny lub decyzje wrażliwe na zgodność.

Zarządzanie

Ryzyko AI nie jest już hipotetyczne, a zarządzanie nie może być już nieformalne. Drzewo decyzyjne Oceny Ryzyka Gen AI ustanawia jasny sposób rozumowania o ekspozycji przed wdrożeniem systemów. Ryzyka są kategoryzowane na ryzyko wejścia, ryzyko systemu i ryzyko wyjścia, co zapobiega zespołom zrównywania całego ryzyka AI do jednej oceny. Ta struktura pomaga organizacjom odróżniać akceptowalne eksperymenty od działań, które wymagają silniejszych zabezpieczeń lub powinny być całkowicie unikane.

Po zidentyfikowaniu ryzyka, model Koszt-Korzyść Leczenia Ryzyka przedstawia redukcję ryzyka jako wybór inwestycyjny. Porównując oczekiwane straty, prawdopodobieństwo wystąpienia i koszt łagodzenia, liderzy mogą uzasadniać wydatki na bezpieczeństwo i zgodność w biznesowych warunkach.

Etyczne rozważania wymagają innego rodzaju rygoru.Trójkątna Ocena Etyki AI operacjonalizuje etykę poprzez projekt systemu, zarządzanie danymi i cykl życia wdrożenia. Mapując zasady etyczne, takie jak sprawiedliwość, odpowiedzialność, wyjaśnialność i prywatność na domeny informacyjne, poznawcze i fizyczne, unika traktowania etyki jako jednorazowej listy kontrolnej. Zamiast tego, podkreśla, że wyniki etyczne ewoluują wraz z skalowaniem systemów, interakcją z użytkownikami i wpływem na rzeczywiste wyniki.

Wnioski

To, co ostatecznie różni udane programy AI, to nie zaawansowanie modelu, ale spójność decyzji. [Name] dostarcza spójne połączenie, które łączy ambicje z ekonomią, wykonanie ze skalą i innowacje z odpowiedzialnością. Zastosuj te ramy, aby przejść poza izolowane sukcesy w kierunku systemów AI, które generują wartość, budują zaufanie i pozostają trwałe, gdy technologie, rynki i oczekiwania ewoluują.